ARTICLES

近年、「AI」や「人工知能」という言葉を頻繁に耳にするようになりましたが、一体どのくらいの人たちが、その真の意味を理解できているのでしょうか? AIのさらなる進化と、AIが人間の知能を超えるという「シンギュラリティ」に警鐘を鳴らす科学者も出はじめましたが、それはなぜなのでしょうか? 私たちがAIに対して抱えているぼんやりとした不安を払拭し、AIの実像を理解して冷静な議論を進めるため、人工知能学会会長の山田誠二さんに、「AIとは何か」、あらためてお話を伺いました。

<プロフィール>

山田 誠二 氏

人工知能学会 会長/国立情報学研究所 教授/総合研究大学院大学 教授/東京工業大学大学院 特定教授

HAI(ヒューマンエージェントインタラクション)、IIS(知的インタラクティブシステム)の2つの研究分野を世界に先駆けて展開し、人とコンピュータシステム、マシンとの協調を目指して、人工知能、計算知能の方法を駆使したインタラクションデザインの工学的設計論を研究している。2016年に一般社団法人人工知能学会の会長に就任。 http://www。ymd。nii。ac。jp/lab/seiji/

*HAI (Human-Agent Interaction) とは、人間と擬人化エージェント、人間とロボット、そしてエージェントを介した人間同士がうまく協調するためのインタラクションデザインを目指す新しい研究領域。

*IIS (Intelligent Interactive Systems) とは、人間と機械学習・データマイニングシステムの知的なインタラクションデザインを目指す新しい研究領域。

そもそも、AIの定義とは何か?

NWF:そもそもAIの定義とは何でしょうか?

山田:極端に言うと、研究者によって定義が違うくらいに曖昧です。一般的にコンセンサスが得られているのは、『人間と同じような知的な処理をコンピュータ上で実行するもの』という定義があります。

ただ、今の定義の中には定義されていないものがあって、人間並みとはどのくらいか? 知的な処理とは何か? ということ。これは分からないんですね。AIを研究していると、人間が知的だと思っていないことが意外と知的だったり、人間が簡単だと思っていることが難しかったりする。ここから先は哲学に入ってくるので踏み込むと出てこられないというか(笑)、工学者ではなくなってくるので、私は踏み込んでいません。

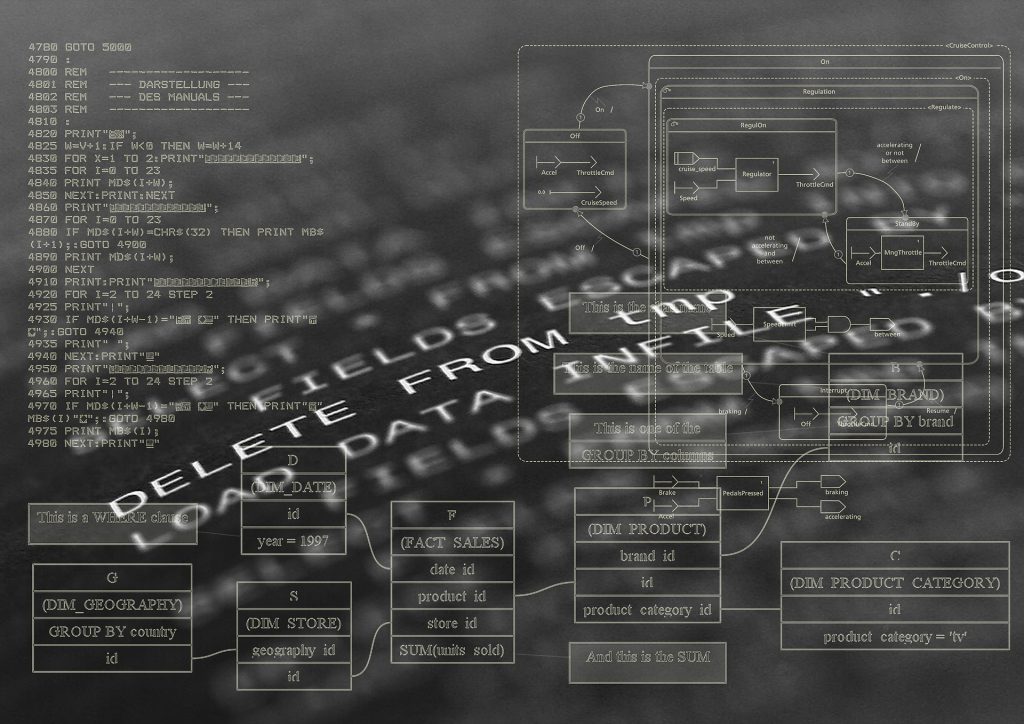

この定義の面白いところはコンピュータ上で実現するというところです。もともとAIは計算機科学からきているので、その志向性は強い。簡単にいうとプログラムとして実現すること、プログラムを書くということです。生物をいじる遺伝子組換えをして、細胞レベルで実現しようとしている人はごくごくわずかですね。

AIは何をやっているのか?「アルゴリズム」と「プログラム」の違い

NWF:私たち身の回りの生活で既にAIが入っているものはどのくらいあるのでしょうか? 例えば家電にもAIは使われているのでしょうか?

山田:先ほどの定義に少しでも当てはまるものはAIと言えます。人工知能は何をしているかというと、アルゴリズムを作っているんです。アルゴリズムとは、プログラムよりも抽象化した手続き・手順(フローチャートのようなもの)のことを言います。いろんな賢そうなアルゴリズムを作るAIを、研究者が日々開発しています。論文の数だけ違うアルゴリズムが提案されるので、おそらくアルゴリズムは何千以上もあります。AIアルゴリズムを元に書いたプログラムが入っていたら、AIが導入されていると考えていいと思います。

企業が出しているものは、基本的には中のプログラムが分からない、見えない場合が多いんですね。どういうことを言ったら何が返ってくるか分かるけれど、中でどんな処理をしているかは分かりません。AIのアルゴリズムを使っているとすればそれはAIですが、他の可能性として、AI以外の普通のプログラムを使っている場合もあるでしょう。もう少し詳しく言うと、ある種の「機械学習」をしていると、それはAIだと言っていいと思います。

第3次AIブームというのが続いているのですが、それを最も牽引しているのが機械学習です。AIの技術は何百もありますが、そのひとつが機械学習なんですね。その応用が実用化レベルになってきて、よく使われるようになりました。機械学習が高い性能を示すには、データが大量に必要なこと、安くて速い計算器が必要なのですが、やっと最近その両方が揃ってきたところです。

現在のAIは、人間の1歳児くらい?

NWF:機械学習ができはじめたということで「AIが幼稚園レベルになった」と言われますが、実際のところはどうなのでしょうか?

山田:幼稚園児にもなっていないです。まだ1歳くらいかな。幼稚園児は人間の行動を見て理解できるし、嘘をつくこともできますが、まだAIはそういうことができません。

例えば、私たちは目の前にある紙コップに入っているお茶を見て、素材は紙で、中はお茶だと瞬時にわかりますが、AIにはできない。人間は世界中のあらゆるお茶を飲まなくても、2〜3種飲めばだいたいそれが「お茶である」とわかりますね。しかしAIがすべてのお茶を飲むのは不可能ですし、そういう2〜3の経験や学習をうまく残す方法がわかっていないんです。また、人間は遺伝子を持っていますが、AIには遺伝もないし生殖もしないですよね。

進化論では、親から遺伝で受け継ぐことと、生まれて育っていくうちに自分で経験して学習していくこと、どちらの影響が強いのかは議論が終わっていません。AIに遺伝はありませんが、プログラマーがプログラムを書くときにパラメータの初期値を決めるので、これがある種の遺伝のようなものだと言えるかもしれません。AIにはプログラマーの主観が入っているということです。

NWF:機械学習の他に、どのようなAIが実用化されてきていますか?

コンピュータ言語ではなく人間が使うような自然言語を処理するAI、例えば「自動翻訳」にもAIが使われています。スマートスピーカーでごく一部で実現しているのが、話しかけると応答する対話です。しかし、Siriのようなものはあくまで情報検索であって、人間並の日常会話はまだできません。

人間が言った言葉をテキストにする「音声認識」というAIも使われています。テキストにした後にそれがどんな意味なのか考える、意味がわかったらどう答えるかを考えるのが「自然言語処理」、「対話処理」というAIです。返答する言葉が決まったら音にする、人間のような自然な声で返すのがなかなか難しいのですが「音声合成」と言われるAIもあります。

これだけでも、音声認識・自然言語処理・対話処理・音声合成と様々なAIの技術が使われているわけです。そこに、だんだん何回も聞いてうまく答えられるようになると、機械学習が入ってくる。究極に統合されたら、人間とスムーズに話せるロボットが出てくるかもしれませんね。

人間にはAIが何をやっているのかわからない、解析もできない

NWF:2045年に「シンギュラリティ」が起こると言われていますが、山田先生はどうお考えですか?

山田:2045年頃に人知を超えるAIが実現し云々という意味でのシンギュラリティは噴飯ものと言っています。たぶん、できないでしょうね。

机上の空論にさえなっていないと思います。根拠もありません。ハードウェアが指数関数的に伸びるというのはある程度できるかもしれませんが、ハードが伸びればシンギュラリティが起こるわけでもない。アルゴリズムが指数関数的に伸びれば良いのでしょうが、そうはなっていません。

どうしてそうならないのか? 例えば、今の数学では解析が難しい機械学習アルゴリズムがたくさんあるからです。ディープラーニングは特にそうですが、解析ができないんです。ある事象に対して、それがなぜ成功したのか、なぜ失敗しているのかが分からない。例えばAIが花瓶をコップと言いはじめたとして、どこかがおかしいはずだけど、中を見ても何がおかしいかが分からないんです。仕方がないので「花瓶はコップではない」と訓練データで経験をさせて、また何かを間違えたら、それも教えていく。どこまで教えていけば、人間のレベルになるのか分からないし、非常に難しいと考えられます。

NWF:ある日突然に、爆発的に成長するかもしれないというのはあり得ますか?

そこは研究段階でもよく分かりません。AIの考え方を解析するための道具がない、基本的には数学なのですが。ディープラーニングは特に、ものすごく複雑なんです。ある意味それだけ複雑だから人間レベルの複雑なことができるのでしょうが、中身が分からないのは人間の脳も同じような感じですね。

人間のことが解析されていけば、AIも進むというのはあり得ることです。ただ、AIにも大きく二つのアプローチあって、ひとつは人間の脳に学ぶこと。脳科学で知見が得られれば使える。もうひとつは数学でやってしまうこと。これは脳とは関係ありません。

この2つのアプローチのどっちが早く進歩するかは分かりません。今はディープラーニングの性能が上がっているけれど、7〜8年前までは統計数学を使った数学からのアプローチが勝っていたのですから。数学的アプローチの場合、数学でやるので理屈がつく場合が多いんです。理論的にしっかりしている。理論的にしっかりしていると、げきることとできないことがわかる。

しかしディープラーニングは理論がないので、どこから先ができるのかできないのか明確には分からない。やってみるしかないんです。今できないと思われたことが3年後にできるかもしれない。数学ベースはできないと言われたことはできない。数学でできないと証明されているのでどやってもできないわけです。

AIに人間の仕事が奪われることは、今のところあり得ない

NWF:仕事が奪われたり、AIが暴走してターミネーターの世界になったり、というような映画のようなことが実際に起こる可能性はあるのでしょうか?

山田:今のところはあり得ないでしょうね。人間の仕事が奪われるというのは、人間の仕事が丸ごと奪われるのではなく、既存の職業が担っている仕事の一部が奪われる、AIでできることをやってくれると考えるべきです。自分の仕事のどこがAIで代替可能かを意識しないと、自分の仕事を効率化できないし、会社のどの部署のどんな役割が代替できるかを考えないと、会社組織全体を最適化できないでしょう。ただそれは、ITの導入時も一緒でしたよね。

産業革命後の機械化で肉体労働の一部の仕事が無くなったのと同じように、AIで代替可能な仕事が出てくるのはありえると思います。ただ、いわゆるコンピュータが導入された時に比べると影響は限定的なように感じます。コンピュータの時は、計算に関係しているところがすべて代替されているわけですから。

NWF:AI研究が抱える現在の課題と限界は何でしょうか?

山田:よく悪くもディープラーニングが引っ張っているのですが、ディープラーニングは学習した結果を人間が理解できない。いかに解析するか、パラメータの羅列が億単位であるので、それを人間にも理解できるように可視化できればよいのですが、それがなかなかできていません。

現在のディープラーニングは、中間層が120層以上のもあるのですが、1〜2層目は可視化できるけれど、4層目以降は人間には理解できない。何ができているか理解できないんです。1〜2層目は比較的人間の視覚の直感に合っていて、斜めの線とか、ある曲線を認識しているらしいと理解できるけれど、その後がわからない。

わからないというのは、間違ったときに手を入れて修正することができないということです。間違った例を教えなおすということでしか修正できないので、命に関わるようなところには使いづらいのではないか、と思っています。性能は高いけれど、説明ができないし責任を持てない。

暴走するAI、自動運転は本当に安全なのか?

NWF:人間が解析できないままAIが暴走していくということは本当にあるのでしょうか? 映画のように、AIが発達して人間を排除するみたいなストーリーが…?

地球にとって人間がいないほうが最適だというのは前から言われていることですね(笑)。AIがそういう考えを持つことはあり得ることですが、人間を排除する方向にいくかというと、どうでしょうか。AI自体は人間がつくるものなので「ロボット三原則」のようなものをプログラムしておけば、基本的にやらないでしょう。

しかしプログラムの暴走はあるかもしれません。AIに限らずコンピュータプログラムもごく希に暴走はしますし、あらゆるプログラムにバグはあると言われています。AIの場合、システムがそんなに複雑でなくても、人間が見てよくわからない動きをするんですね、書いた人自身が見ても。そういう意味では扱いにくい、バグを見つけにくいというのはあると思います。ここでも、AIの挙動を可視化する技術が重要になるでしょう。

ただ、基本的にテクノロジー自体は中立なんです。悪意も善意も持っていない、使う人間によって良い方向にも悪い方向にもいく、原子力もそうですよね。そういうテクノロジーの研究開発自体に制限を加えるというやり方は、なかなか問題が多いのではないかと感じます。もちろん使い方は規制したほうが良いと思いますが。

NWF:人間の倫理感や、法律に頼らざると得ないということですね。

そうです。それしかないと思います。AI自体は倫理も何もない、人間に書かれたプログラムを実行しているだけなので、人間次第。それはあらゆるテクノロジーも一緒です。

例えば、いま自動運転が話題になっていますよね。 自動運転車にもAIが入っていますが、もしその車が人身事故を起こしたときに、従来の裁き方で良いのか? 製造業者が責任を取るということになるかもしれませんが、隣には人が乗っているわけで、その人に責任はないのか? など。まだ裁判にはなっていないと思いますが、自動運転車で既に死亡事故は起こっています。そして保険はどうするのか? 自動運転車同士がぶつかったらどうするのかなど、今はその辺りの議論をすっ飛ばして実験しています。

自動運転にはレベル0から5まであって、5の完全自動走行はファンタジーだと某自動車会社の方は言っていました。ただ、買い物難民の高齢者がいるような路線バスのない地域では、完全自動運転は必要になってくるでしょう。そのような地域で、決まったルートを周るのは比較的ハードルが低いと思いますが、一般道ですぐ任意の目的に行けというのはまだ難しいですね。

自動運転で面白い話は、日本は左側通行なので、右折が難しいそうです(笑)。車線を横断する必要があるので。都市計画するときに全て左折で任意の場所まで行けるようにすると非常にありがたいと、関係者が言っていました。AIの能力に環境が合わせる、それもひとつの解決策ですよね。これをインフラレベルでは行うのはなかなか難しいと思いますが。

人工生命と人工知能の違いは何か? ウィルスは生命なのか鉱物なのか?

NWF:AIに環境や人間が合わせていくのも本末転倒な感じがしますね。将来的にAIやロボットが社会に浸透していくとき、どこからが生命なのか、どこから人権が発生するのか、ロボットに人権はあるか? そういう問題も発生しそうですね。人間の一部が機械に置き換わることもあるかもしれません。

山田:人間の一部は機械に置き換わるのでしょうね。攻殻機動隊みたいにね(笑)。生命について『シュレーディンガーの定義』というものがあります。これは、エントロピーで定義するというものです。地球上の非生物はエントロピーが増大方向にしかいかない、生物はエントロピーを維持すると。なぜこれができるのかわからないのだけれど、食料というネゲントロピーを摂取していて、。。身体という構造を維持できるものを生命と名付けるというのはありかなと思います。

人工生命の定義だと、個体保存や成長、複製や増殖、進化などが挙げられますが、その定義に従うとコンピュータウィルスも生物の定義を満たしているという話になります。でも、プログラムを生命であると認めるのは抵抗がありますね。やっぱり個人的には、「なまもの」であってほしいなと。

人工生命の定義では、コンピュータウィルスは「生命」であることになります。そのことで実害はたいして無いような気もしますが、あらゆる生命を殺してはいけないという考えから言わせると、コンピュータウィルスも保存すべきだ、殺してはいけない、消してはいけない、隔離して残すべきだ、となるのでしょう。ロジックとしては成り立つのですが、抵抗はありますよね。

学者が考える定義と、一般の人の直感にズレがあるのはまずいのではないか。普通の人と違う見方をする、そこが学者の存在価値でもあると思うのですが。生命や意識や心について語るとき、普通の人の直感と合わないのはまずいのではないかと私は思います。例えば、本物のウィルスも生命か無機物かの区別がはっきりしていないんですね。自己増殖するし、突然変異もするんですが、限りなく鉱物に近いということです。

現在のAIは人間との協業が考えられていない

NWF:先生はどのようなアプローチでAIを研究してらっしゃるのでしょうか?

山田:私はニューラルネットワークではなく、数学的アプローチのほうです。実はニューラルネットワークとAIは仲が悪かったんです。仲が良かったのは1960年代くらいかな。そこからは袂を分かって敵対していました。最近は、言い方は悪いんですが、野合していると思います。研究の世界もグローバルに派閥があって、日本の派閥はアメリカの派閥を真似てつくっている。ヨーロッパとアメリカでも違いますね。

私自身の研究は、アルゴリズムそのものを作っているというよりも、どちらかというとUI(ユーザーインターフェース)やUX(ユーザーエクスペリエンス)デザインに近いです。AIを人間にうまく使ってもらうためのUIです。

私の興味はここ10年ずっと一緒で、人間AIは単独で動くようにしか作られていないということです。に使ってもらうということが考えられていない。共生・協業・共存という研究が抜けていて、やっと一部で始まりつつあるんです。将来的にAIが導入される現場では必ず人間とのインタラクションが発生します。それはロボットも同じで、ようやくロボットのユーザーが一般に広がってきています。私の研究分野で、日本人の研究コミュニティが世界に発信しているヒューマンエージェントインタラクションHAIは、まさに人間とAIエージェントとが上手くやるにはどうするのかという研究です。

NWF:協業できるAIになるためには、どんな分野とコラボレーションすれば良いのでしょうか?

社会心理学や認知科学に近いです。人間同士で行われているコミュニケーションをAIに応用するアプローチで、うまくいく場合といかない場合があります。特に私の専門の「擬人化エージェント」というのは、人間のようなルックスをしたものがモニターに出てくるのですが、AIとユーザーの関係が人間関係に近くなるんです。だから人間同士の知見が使える可能性が高いんです。

ただ、人間の本質的なことに対する理解ってほとんど進んでいないような気もしますね。本当は大事だと思うのですが、実用性がない。工学の私から見ると、文系不要論は明らかにおかしいと思いますよ。文科系も必要だと思う。きちんとやったほうがいいですね。

ガートナーのハイプサイクル? AIは過大評価されている

NWF:いま最も家庭に入り込んでいるロボットといえばお掃除ロボットだと思うのですが、お掃除ロボットのルンバにはAIが入っていますか?

山田:ルンバを開発しているアイロボット社の元社長はロドニー・ブルックスという人で、マサチューセッツ工科大学のAI研究所の所長だったので、その知見がたくさん入っていると思います。機械学習をしているかどうかわからないのですが。

NWF:ホーキング博士が、一度臨界点を超えるとAIが人間の知能よりも上回ると言っていますが、それについてどう思いますか?

なぜ、ホーキング博士がそう言うのかわからない、そこに興味があります。さっきから言っているように、私は世俗的な意味でのシンギュラリティは起こらないと思っているので、その発言の背景がわからない。背景が明かされていないので、それを知りたいですね。

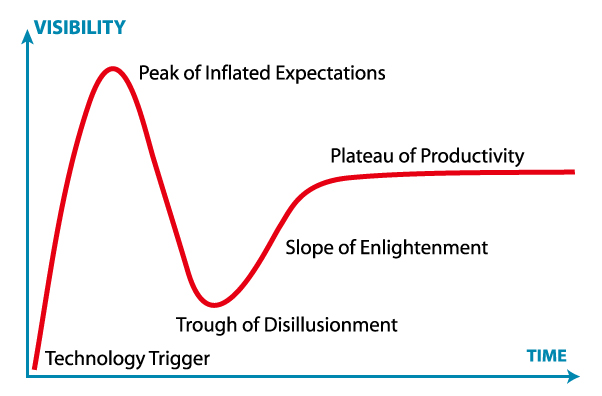

全体的にAIは過大評価されていると思います。AIをよく分かっていない人ほど過大評価する傾向があるので、そこの是正をしないといけないというのは、人工知能学会でもよく話題になっています。ガートナーのハイプ・サイクルではAIが頂上にいて、IoTは落ちはじめていて、ビッグデータはどん底です。

CC BY-SA 3。0、Gartner Hype Cycle。svg、Jeremykemp at English Wikipedia

AIの研究トレンドはだいたい20年周期で繰り返しますから、その分野でトップを走るには、今やっていることを20年以上やるのが一つの方法です。ディープラーニングの元をつくった日本人研究者の福島邦彦先生は今でもずっと研究されているとお聞きしています。ジェフリー・ヒントン先生はディープラーニングのパイオニアで、彼は30年以上ニューラルネットワークを研究し続けています。ですから、いまからディープラーニングの研究をやっても、もうトップには追いつけないですね。次のAIブームで先頭を走るにはディープラーニングの次をやらなければならないのですが、それが果たしてどんなAIなのか、今はまだわかりません。